Átláthatóság, társadalmi igazságosság és emberi jogok – szempontok a digitális platformok szabályozásához

A Political Capital techszektor-szabályozásáról szóló vitaindító írása egy kérdésfelvetéssel indul: bűnbakkeresés vagy társadalmi igazságosság? Valójában ez nem vagy-vagy kérdés. A szabályozási keretrendszer kialakításakor ugyanolyan fontos, hogy érvényesüljenek a társadalmi igazságosság elvei, mint az, hogy megvalósulhasson az elszámoltathatóság a megfelelő szereplőkkel szemben. WESSENAUER VESZNA, a Ranking Digital Rights kutatási menedzsere szerint ehhez az kell, hogy a techcégeket átláthatóságra ösztönözzük, és hogy számon kérjük rajtuk emberi jogainkat.

A probléma: érdekellentétek és üzleti modell

Amikor techcég-szabályozásról beszélünk, nagyon könnyen el lehet veszni a szerteágazó jogi kérdések rengetegében, pedig az alapprobléma egyszerű: a vállalatok a profitot választják a közérdek helyett. Üzleti motivációik mindaddig felül fogják írni a demokratikus közérdeket, amíg a politikai, gazdasági és jogi környezet ezt lehetővé teszi.

A techóriások üzleti modelljének fontos eleme a célzott hirdetések és az algoritmikus tartalom moderálása. E technológiák segítségével ma már képesek olyan felhasználói elérést generálni, amilyenről a Google megalapításakor Larry Page and Sergey Brin álmodni sem mert. Ezzel nemcsak saját maguknak termelnek gazdasági tőkét, hanem mások számára is lehetővé teszik politikai tőke felhalmozását, milliók politikai nézőpontjának befolyásolását.

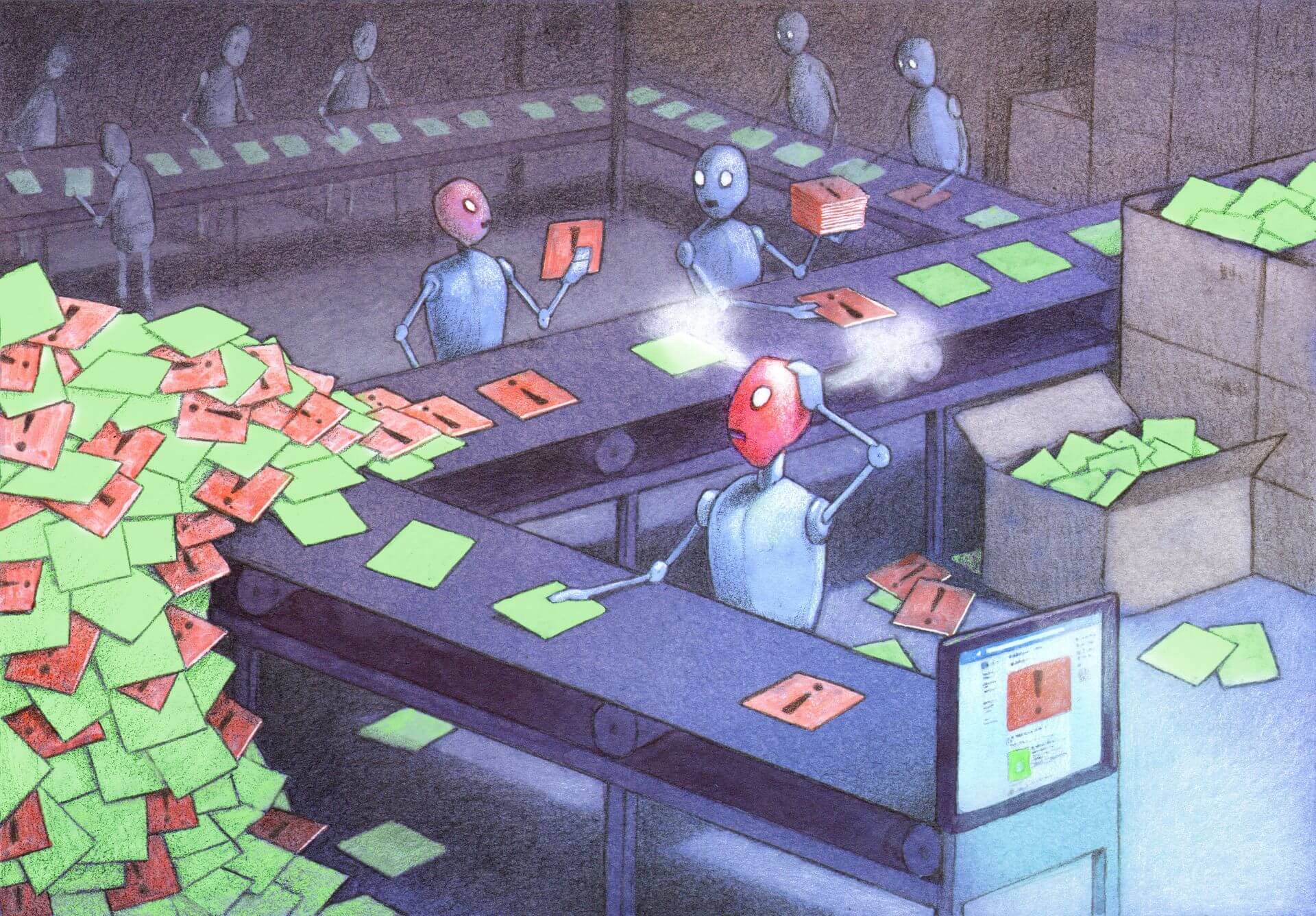

Az tehát, hogy a digitális platformok sorra kudarcot vallanak a problémás, gyűlöletkeltő, valótlan vagy manipulatív tartalmak kezelésében, leginkább azért van, mert üzleti modelljük erre van optimalizálva. A platformok soha nem lesznek képesek az összes problémás tartalom eltüntetésére az internetről. Ahelyett tehát, hogy felelősségre vonnánk őket a felhasználók által közzétett tartalomért, és hagynánk, hogy a szólásszabadság érzékeny kérdéseiről szóló jogvitákban hozzanak döntéseket, inkább arra kellene a jogalkotás során összpontosítani, hogy milyen szerepet játszanak a problémás tartalmak felerősítésében és terjesztésében.

A platformok „tartalomalakító” algoritmusai a legtöbb felhasználói nyilatkozatban egy-egy mondat erejéig merülnek fel, mint olyan eszközök, amelyek segítik, hogy számunkra releváns tartalmakat láthassunk. Ugyanezek az algoritmusok a mozgatórugói a problémás, manipulatív tartalmak terjedésének. A platformok felhasználói viselkedésünk alapján további adatokkal táplálják („tanítják”) az algoritmusokat, és az így keletkezett, sokszor számunkra is ismeretlen, digitális profilunk alapján ijesztően személyre szabott online tartalomfogyasztási élményben lehet részünk, amellyel egyúttal szabad informáltsághoz való jogunkat lehetetlenítik el. Azzal, hogy algoritmusok alakítják online információs környezetünket, megfosztanak a szabad felfedezés lehetőségétől, ami a Netflix egysíkú filmajánló algoritmusa esetében csupán idegesítő, de egy választási kampány során politikai tartalmakat rangsoroló algoritmus esetében jogsértő is lehet, és a választási eredmények alakulását is befolyásolhatja.

Ezek az automatizált, célzott hirdetési rendszerek lehetővé teszik, hogy bárki reklámokat vásároljon a digitális platformokon, és manipulatív vagy félrevezető üzenetekkel célozza meg jól körülhatárolt célcsoportját. Ez az eljárás már csak azért is problémás, mert lehetővé teszi például, hogy egy hirdető csak bizonyos korú, iskolai végzettségű, nemű és származású felhasználóknak mutasson álláshirdetéseket, ami a diszkrimináció melegágya.

Fotó: Paweł Kuczyński

A legtöbb platform esetében semmit nem tudunk ezeknek az automatizált rendszereknek a működéséről, vagy arról, hogy a politikai szereplők miként használják őket. Épp ez az, ami lehetetlenné teszi a megalapozott vitát: amíg a legalapvetőbb információk sem állnak rendelkezésünkre, addig a megoldásokhoz és a techszektor megfelelő szabályozásához sem fogunk közelebb jutni.

Az elszámoltathatóság elengedhetetlen eleme: átláthatóság

Átláthatóság nélkül nincs elszámoltathatóság, és ez igaz a techóriásokra is. Amikor egy platform olyan alapvető kérdésekről nem biztosít információt, hogy hogyan alakítják az algoritmusok az információs környezetüket, akkor a szólásszabadsághoz való jogunkat sérti meg. A szólásszabadsághoz való jog ugyanis „anyajogként” magában foglalja a szólás- és sajtószabadság mellett az információhoz jutás szabadságát is.

Az átláthatóság nem képes orvosolni az összes jogsértést, de az átláthatatlanság komoly akadálya az elszámoltathatóságnak és jogaink gyakorlásának. Tény, hogy a techcégek nem állami szereplők, tehát nem várható el tőlük az átlátható működésnek ugyanaz a foka. Az elmúlt évek eseményei mégis megmutatták, hogy alakítóivá tudnak válni jelentős politikai, társadalmi és gazdasági folyamatoknak is. Ez már önmagában indokolja, hogy ne egyszerű piaci szereplőként tekintsünk rájuk.

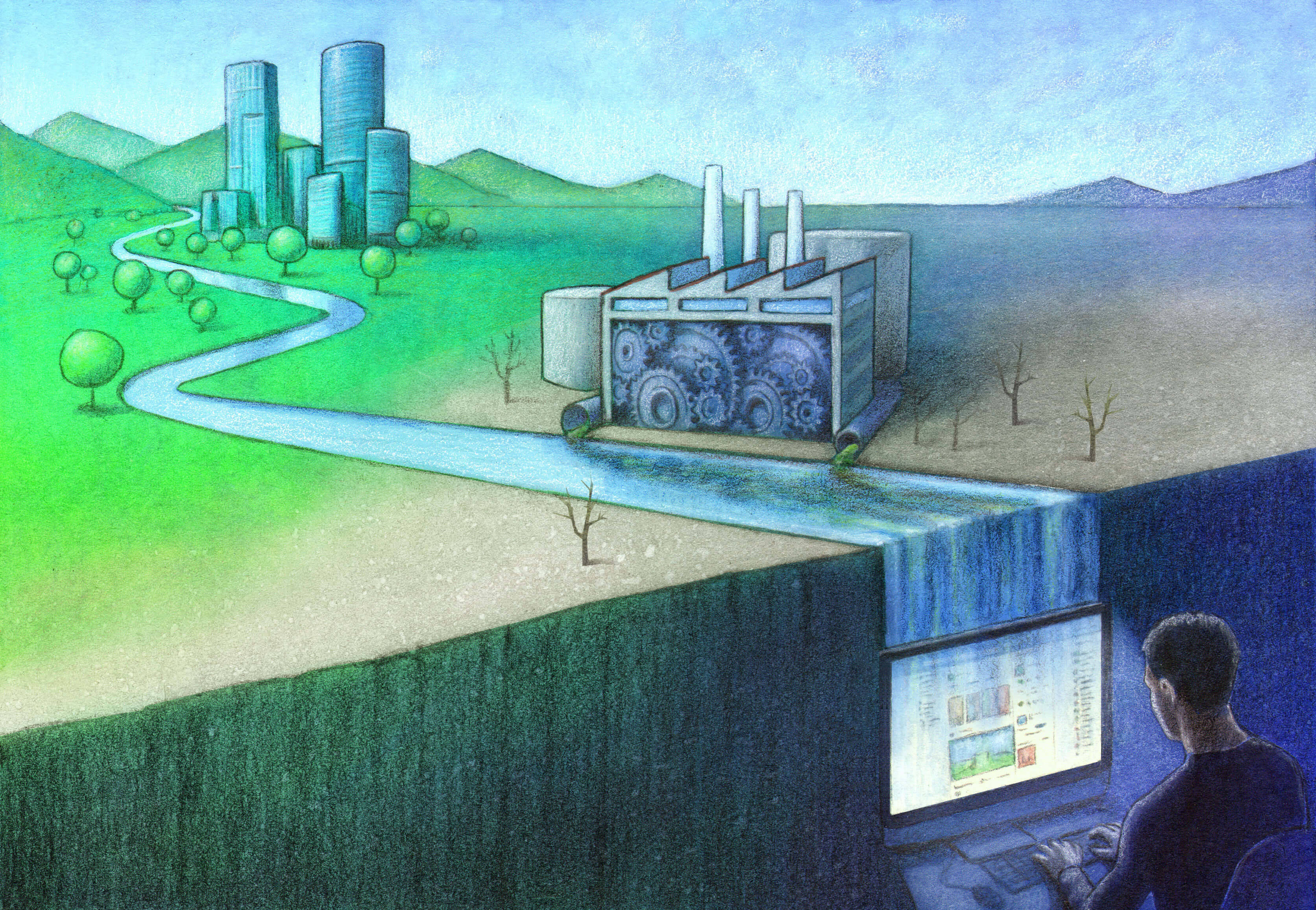

Fotó: Paweł Kuczyński

Talán nem közismert, hogy az emberi jogi felelősségre vonatkozó ENSZ-irányelvek szerint egy üzleti vállalkozásnak is tiszteletben kell tartania az emberi jogokat. A Ranking Digital Rights (RDR) kutatócsoport, amelynek én is tagja vagyok, olyan átláthatósági emberi jogi sztenderdeket alkotott, amelyek az ENSZ-irányelvekkel és az Emberi Jogok Egyetemes Nyilatkozatával összhangban kérik számon a techóriásokat. Évről évre publikált eredményeink jól mutatják, hogy a techóriások még a közelében sincsenek annak a szintű átláthatóságnak, amely lehetővé tenné az érdemi számon kérhetőséget.

Emberi jogok, átláthatóság és algoritmusok

Nem elegendő azt követelni, hogy „működjenek átláthatóan a techcégek!”. Ennél részletesebb iránymutatásra van szükség, és ezért fontos minél pontosabban specifikálni, hogy mit értünk átláthatóság alatt, és hogy milyen emberi jogi kötelezettségvállalás várható el a digitális platformoktól.

Az utóbbi időben a legtöbb fejtörést az algoritmikus rendszerek átláthatósága okozza. Eleve alig áll rendelkezésre erről információ, a rendszerek technikai aspektusa miatt pedig nem egyszerű ésszerű átláthatósági követeléseket megfogalmazni. Mégis vannak olyan alapinformációk, amelyek már segítenének abban, hogy jobban megértsük az algoritmikus rendszerek működését és a felhasználói jogok helyzetét.

Először is fontos, hogy emberi jogi keretben beszéljünk az algoritmikus rendszerekről. Amennyiben ugyanis megállunk az etikai keretrendszernél – ami egyébként népszerű hozzáállás a Szilícium-völgyben –, az elszámoltathatóságot lehetetlenítjük el. Kormányközi szervezetek, köztük az Európa Tanács és az ENSZ szólás- és véleményszabadság előmozdításával és védelmével foglalkozó különleges jelentéstevője megállapították, hogy a nemzetközi emberi jogi keretrendszer alkalmazása az algoritmikus rendszerek szabályozására nem csupán normatív sztenderdeket fogalmazna meg arra vonatkozóan, hogyan lehet „nem ártani” vagy „etikusnak lenni”, hanem ténylegesen biztosítaná a jogorvoslat és az elszámoltathatóság lehetőségét is.

Tudjuk, hogy a techcégek rengeteg adatot gyűjtenek rólunk, amelyeket aztán algoritmusok segítségével kategorizálnak, és ez alapján dől el, mit látunk a képernyőnkön, keresési eredményeinkben, a ránk targetált hirdetésekben stb. Ennek ellenére nagyon kevés olyan platform van, ami érdemben tájékoztatna arról, hogy milyen formában és miért használják fel érzékeny, személyes adatainkat algoritmusok alakítására. Az első lépés tehát az lenne, hogy megfelelő helyen, érthetően és befogadható részletességgel adjanak tájékoztatást a platformok arról, hogy hogyan fejlesztik az algoritmikus rendszereket, milyen módon használják erre a felhasználók adatait, és mit tehetnek a felhasználók, ha nem szeretnék az algoritmikus rendszereket adataikkal táplálni.

Arról sincs tudásunk jelenleg, hogy hogyan működnek az algoritmusok, miután a felhasználók adatai bekerülnek a rendszerbe. A legtöbb esetben még azt sem tudja a felhasználó, hogy pontosan milyen faktorok alakítják a virtuális valóságát, mi alapján kerülnek bizonyos tartalmak elé. A platformoknak feladatuk lenne információt biztosítani arról, hogy milyen paraméterek alapján rangsorolják a tartalmakat a keresési eredményekben vagy a hírfolyamokban. A nagyobb átláthatóság segítene abban, hogy megértsük, miért kerülnek előre szélsőséges tartalmak a YouTube keresési eredményeiben, és lehetővé tenné a platform számonkérését is.

Fotó: Paweł Kuczyński

Kérdés az is, hogy a platformok megvizsgálják és monitorozzák-e azt, hogy az általuk fejlesztett és használt algoritmikus rendszerek mennyiben veszélyeztetik az emberi jogokat. E nélkül könnyen kialakulhatnak olyan helyzetek, mint a mianmari genocídium, ahol az előzetes emberi jogi, politikai és társadalmi kockázatok felmérésének hiányában a platform által alkalmazott tartalommoderálási módszerek (köztük az algoritmikus tartalommoderálás) nem tudták figyelembe venni a lokális etnikai konfliktusokból származó kockázatokat. Kevés vagy semmilyen információnk nincs arról, hogy milyen rendszerességgel és milyen szempontok alapján folytatnak ilyen felméréseket a platformok. Ez azért is probléma, mert elkeni a techcégek felelősségét egy-egy politikai konfliktus kialakulásában.

Merre tovább?

Megfelelő szabályozási keretrendszer hiányában, amely arra kényszerítené a platformokat, hogy tegyék átláthatóvá és elszámoltathatóvá algoritmikus rendszereiket és működésük egyes területeit, jelenleg a civil társadalom feladata ezeknek a követeléseknek a kikényszerítése és napirenden tartása. A jó hír az, hogy az EU-s szintű jogalkotásban erős prioritást élvez a platformok szabályozása, és komplex szabályozási folyamatok zajlanak épp, többek között a mesterséges intelligencia kérdésében is. A rossz hír pedig az, hogy a platformok lobbierejével szemben nehezen tudják a civil hangok érvényesíteni követeléseiket. Itt jönnek be a képbe az államok: az ő szerepük nagyon fontossá válik abban, hogy mennyire sikerül átlátható, társadalmilag igazságos, emberi jogokat tiszteletben tartó szabályozási keretrendszert létrehozni.

Az EU-n belül fontos azonban, hogy a kormányok ne tagállami, hanem uniós szintű szabályozásban gondolkozzanak a jogalkotás során; így jóval nagyobb eséllyel lehet szisztematikus változást elérni. Ha egy EU-tagállam valóban az állampolgárai jogait veszi figyelembe, és nem csupán saját politikai érdekei hajták, akkor azért fog küzdeni, hogy a techóriások felhasználókat kizsákmányoló viselkedését átfordítsa egy elsődlegesen közérdeket szem előtt tartó viselkedésbe. Ehhez viszont muszáj lesz az üzleti modell kérdésével és annak átláthatóságával kezdeni a szabályozás megalkotását.

A techóriások elfogadták, hogy számolniuk kell a tartalommoderálás költségeivel, ezzel kapcsolatban egyeztetniük kell állami és civil szereplőkkel. Olyannyira elfogadták ezt, hogy már üzleti érdekükké vált a nyilvános platformok szabályozásáról szóló vitát a tartalommoderálás szintjén tartani, megelőzve azt, hogy a célzott hirdetéseken és algoritmikus rendszereken alapuló üzleti modelljük kerüljön a jogalkotók fókuszába.

A célzott hirdetésekből származó bevételekre való támaszkodás arra ösztönzi a vállalatokat, hogy olyan platformokat hozzanak létre, amelyek függőséget okoznak a felhasználói oldalon. Az üzleti modell szabályozása alatt tehát a célzott hirdetések és az algoritmikus rendszerek működésének átláthatóbbá és ezáltal elszámoltathatóvá alakítását értjük.

Több digitális jogokkal foglalkozó kormányközi és civil szervezet, köztük a Ranking Digital Rights is specifikus ajánlásokat fogalmazott meg arra vonatkozóan, hogy mivel lehetne növelni a vállalati átláthatóságot, célzott hirdetési előírások, valamint felhasználói tartalomra vonatkozó szabályok terén. Arra vonatkozóan is vannak ajánlások, hogy hogyan lehetne a „vállalti kormányzást” átláthatóbbá tenni, szem előtt tartva az emberi jogokat. A Ranking Digital Rights átláthatósági indexe azt mutatja, hogy a platformok önszántukból minimális erőfeszítést tesznek e téren, tehát a jogalkotók feladata lenne, hogy nagyobb átláthatóságra ösztönözze őket.

Mi lenne, ha a Facebook, a Twitter és a Google csak azokat a célzási paramétereket használhatnák, amelyeket a nyomtatott vagy az elektronikus sajtó?

Mi lenne, ha ezek a platformok nem tennék lehetővé a konkrét személyek targetálását választási időszakban, vagy egyáltalán nem tennék lehetővé a célzott hirdetéseket választások alatt?

Ilyen és ehhez hasonló intézkedések képesek lennének csökkenteni a választással kapcsolatos problémás tartalom terjedését, jelenleg azonban a platformokra van bízva, hogy mit hogyan szűrnek, Az EU-s szintű jogalkotás képes lenne arra, hogy olyan keretrendszert hozzon létre, amely alkalmas az üzleti modell szabályozására – kérdés, hogy mennyiben tudja az állampolgárok érdekeit érvényesíteni az üzleti érdekekkel szemben.

Névjegy

Wessenauer Veszna emberi jogi kutató, a Ranking Digital Rights programmenedzsere. Szakterülete a technológia és az emberi jogok viszonya, a platformok átláthatósága és elszámoltathatósága. Korábban több magyar és nemzetközi civil szervezettel, think tankkel dolgozott együtt, köztük volt a Political Capital, a Democracy Reporting International, az EU-Oroszország Civil Társadalmi Fórum. Emberi Jogi MA diplomáját a Közép-európai Egyetemen szerezte.

A Political Capital a Heinrich Böll Alapítvánnyal közös projektjének keretében érdemi vitát indított a közösségi média szabályozásáról, különös tekintettel annak jogi, etikai következményeire, a dezinformáció terjedésére, a radikalizációra, egyszersmind a demokráciára gyakorolt hatásairól.

A vitasorozat keretében készült további cikkek, egyéb tartalmak itt elérhetők.